核心特性

• 高级推理能力

-1. GPQA基准测试得分56.1%,MATH测试80.4%,超越GPT-4o

-2. 擅长STEM领域任务,数学竞赛题准确率达91.8%(AMC 10/12)

-3. 采用合成数据与拒绝采样技术强化逻辑能力

• 紧凑高效

-1. 140亿参数,体积比Llama 3.3 70B小5倍

-2. 支持4位量化边缘设备运行(如11GB显存)

-3. 资源受限环境下仍保持低延迟推理

• 扩展上下文

-1. 16,000 token上下文窗口(训练中期仅4K)

-2. 高效处理长文本与复杂工作流

• 性能亮点

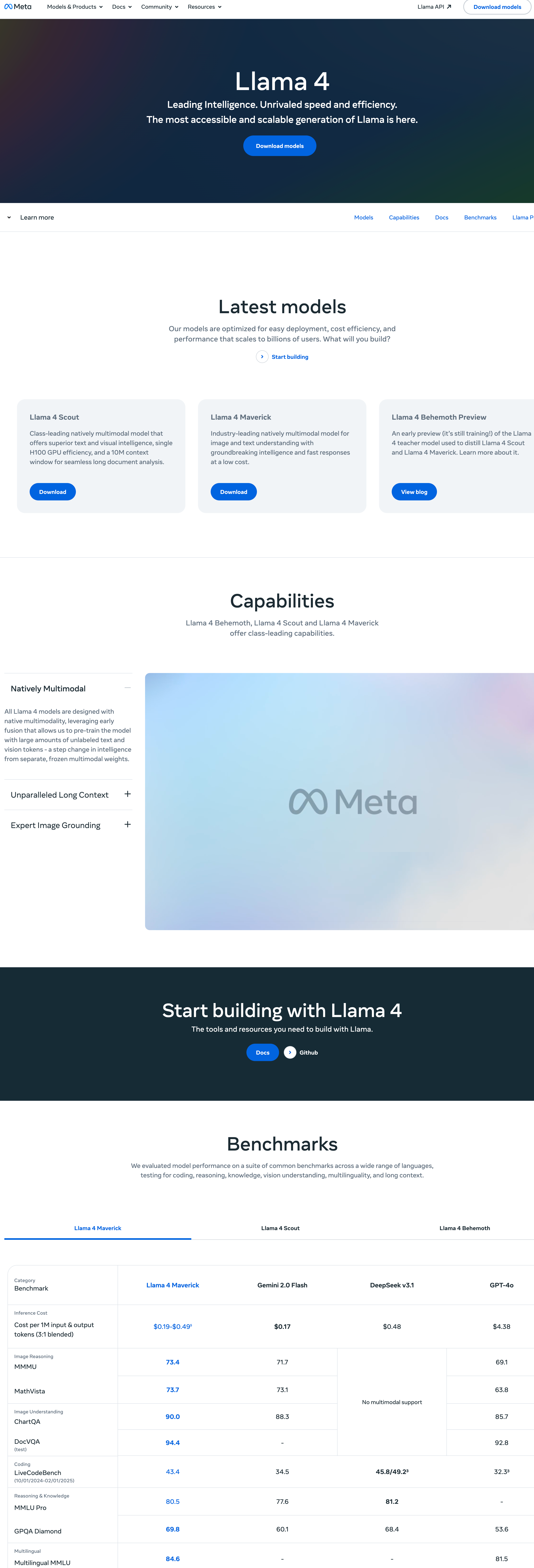

-1. 推理任务表现媲美或优于GPT-4o-mini及Llama 3.3 70B

-2. HumanEval编程测试达82.6%准确率

• 开源可及性

-1. 基于MIT许可发布于Hugging Face与Azure AI Foundry

-2. 支持LoRA微调及vLLM等工具链

• 实际应用

-1. 适用于科研、教育与企业级AI解决方案

-2. 赋能本地化部署与高性价比工作流